“刷脸时代”到来,人脸识别到底有多安全?

越来越多的地方可以刷脸通行了。

据香港南华早报报道,北京的新机场马上要采用人脸识别技术代替人工安检系统,通过系统来捕捉旅客现场的照片与身份证照片进行比对,然后把这个比对值提供给安检工作人员,安检工作人员就可以通过这个值,再根据自己的比对来判断旅客是不是同一个人,相当于增加了一道安全的防护的保障。

人脸识别安检系统安全便捷,智能高效,不仅方便了旅客过检,还解决了在发生突发情况需要核查旅客过检信息时无法实现快速查询、检查效率低、员工劳动强度大、人工成本高等问题。

人脸相比指纹等其他生物特征数据的一个巨大区别就是它们能够远距离起作用。人们只要有手机就可以拍下照片,供人脸识别程序使用。人脸识别技术被设想应用或已经应用于门禁识别、交易支付、公安追踪等众多领域。

不过这也引发了人们关于隐私安全等方面的顾虑。

就像Facebook可以获得人们到访某个景点的信息,然后使用人脸识别技术在自己的网站上找到这些人,向他们发送旅游广告,人们的脸部数据也通常在不知不觉之中被采集和记录下来。

人脸识别是否会带来隐私安全隐患?

如今,执法机关在追踪罪犯方面拥有了一个强大的武器,但它可能会令公民隐私遭受巨大的损害。比如上周五,在谷歌、亚马逊之后,另一家硅谷巨头微软也在内外阻力之下选择和美国政府在人脸识别计划上“分手”了。

最近微软因一份涉及人脸识别软件的政府合同而受到广泛抨击,微软公司表示,它将更加谨慎地考虑这方面的合同,并敦促立法者规范此类人工智能技术的使用,以防止人脸识别技术被滥用。

上周五,微软总裁兼首席法务官布拉德·史密斯(Brad Smith)专门发表了一篇博文,并在里面写道:

“考虑到这项技术被滥用的可能性和广泛的社会影响,政府在人脸识别方面的立法似乎显得尤为重要。”也就是说,“如果没有一个缜密的技术方案,那么政府在决定追捕、调查乃至逮捕哪些人的时候,就将依赖于错误或者带有偏见的技术。”

微软是第一个对人脸识别提出公开质疑的硅谷巨头,但不是第一个受到质疑的科技公司。

今年五月,亚马逊因为正在为政府和警察部门推销其一款名为Amazon Rekognition的产品而被推上风口浪尖,遭到了来自民间自由团体、公司内部员工和众多学者的强烈谴责。

Amazon Rekognition的技术可以实时识别、跟踪和分析人员,并在单幅图像中识别多达100个人。它还可以快速扫描收集的信息,与数据库数千万张面孔进行比对。

消息一发布,瞬间引起了一大波恐慌,美国公民自由联盟组织了30多个民权组织联合抗议亚马逊和政府的合作,要求亚马逊CEO贝索斯停止向政府出售Rekognition。

大部分抗议者认为,如果政府可以利用精准的人脸识别,那么就将利用这个系统跟踪和监视民众,个人隐私就会被公共权力毫无边际地侵犯。Rekognition 技术的广泛使用会给有色人种、非法入境移民、抗议示威民众的人身自由权利带来可怕的后果。

亚马逊内部的100多名员工更是向CEO杰夫·贝索斯(Jeff Bezos)递交了一份公开信,要求公司停止向ICE和其他执法机构出售侵入性和违宪的Rekognition面部识别技术。

这些员工在声明中言辞激烈地写到:“我们公司不应该干监视群众这种蹚浑水的事情;更不应该和警方在安保方面有过密的合作;我们不应该支持那些监督和压迫边缘人群的公共权力机构。”

如果没有一个不带偏见的技术,那么执法部门就可能利用这些带有偏见的算法或缺陷的技术方法来决定跟踪、调查,甚至逮捕哪些人,从而做出不公正的结论。

但是科技公司真的会因为各方的抵制而停止与政府和军方在人脸识别领域的合作吗?恐怕不。

亚马逊的 AI 负责人 Matt Wood 在回应抗议声的博客中写道:

“新技术能力一直都存在风险,以后也会如此。每个选择使用技术的组织必须采取负责任的行动,否则就得面临法律惩罚和公众谴责的风险。AWS 会认真对待自己的责任。但我们认为,不能因为某些技术未来可能被人滥用就禁止这些技术的发展,这样是不对的。”

无独有偶。

因和五角大楼合作展开Maven项目而饱受指责的谷歌在宣布人工智能7大原则之后仍然给自己留了个台阶,表示将继续与美国政府和军方开展在网络安全、培训、退伍军人医疗保健、搜救和军事招聘方面合作。这家网络巨头正在争取两项数十亿美元的国防部门办公和云服务合同。

人脸识别的偏见与缺陷

虽然人脸识别已经成为AI 领域应用最广泛的技术之一,但在推广过程中仍然争议不断。

其实,早在2016年,FBI就开发过一个人脸识别系统,背后还有一个41.1亿张照片的数据库。

当时FBI通过与18个州交换合作,得到了签证、护照、国防生物识别数据库、驾驶证等证件上的照片——以及3千万张曾经犯罪的入档照片。

FBI还为这个数据库专门取了个“下代识别”(Next Generation Identification)的名称。

然而,据英国卫报报道,FBI 的人脸识别算法准确率只有85%,并且往往会有两种失误情况:一种是错误匹配,冤枉了无辜的平民;另一种则是漏报,即错误放走了出境或入境的罪犯。而识别系统在识别黑人比识别白人的出错率更高,也就是说在执法时,黑人被误判的几率更大。

这暴露了人脸识别系统通常具有出错率高的缺陷,尤其是难以识别和区分肤色较深的人。

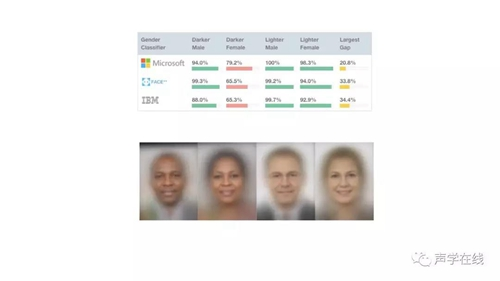

MIT Lab一项名为《Gender Shades》的研究项目就发现,人脸识别软件中的不同性别和肤色的人的时候会产生偏差。在浅肤色男性的错误率为0.8%,而对于深色皮肤的女性则错误率高达34.7%。研究人员将这种偏差成为“算法偏见(algorithmic bias)”。

黑人研究人员Joy Buolamwini选择了微软、IBM和旷视(Face++)三家的人脸识别API,对它们进行性别判定的人脸识别功能测试。但是她发现只有两个平台能识别出她的脸,而且这两个平台都把她的性别给弄错了。

为了证明她不是特例,Buolamwini于是尝试分析这些人脸识别技术软件在识别不同人种、不同性别方面的准确率,结果发现这几个人脸识别系统对肤色较深的女性的分类误差率更高。

她解释说,这种“算法偏见”(algorithmic bias)存在的主要原因首先是训练图像和基准数据集缺乏多样性,其次是深色人种人脸特征较难提取,这两点限制了人脸识别技术的准确性。

由于人工智能很大程度上依赖于训练数据,所以对人工智能进行训练的数据情况,将在很大程度上决定AI的智能程度。因此,如果用来训练AI模型的数据集中,白人男性的数据多于黑人女性,那么系统对后者的识别能力就会不如前者。

Joy Buolamwini指出,如果这些人脸识别技术用于移民案件管理或者贷款发放评估方面,那么产生的不靠谱的结果将使很多人得到不公正的待遇。

Kairos(人脸识别及 AI 技术初创公司)的 CEO Brian Brackeen 发表了一篇反对将人脸识别应用在执法工作中的文章。

文章中写道,在种族歧视严重的美国,非白人受到更严格的审查,人脸识别只会加重“不平等”。在数据库还不够完善的当下,让技术去“指认”一个人是否犯了罪是极其不负责任的。乔治城大学法律学院隐私与科学中心的研究就表明,接近一亿二千万的美国人成为美国政府人脸识别技术的应用对象。而这一个数据在中国则更加庞大。

鉴于人脸识别技术仍未成熟,如果完全不受监管的话,这项技术可能会对公民平等和人身安全构成威胁。

人脸识别会成为明天的“利维坦”吗?

微软总裁兼首席法务官布拉德·史密斯在发表的博文里面提到:

“正像凡是工具总有两面性,就算是扫把,我们也都可以把它用来扫地,也可以用来敲别人的头惩罚别人。人脸识别技术能够帮助家庭找到失散已久的亲人、也可以帮助警察在茫茫人海中找出准备发动袭击的恐怖分子,这些是它能为我们所利用的好处。但同时,人脸识别技术也带来了根本的关于隐私权和自由表达权利的讨论,这项技术若是被公共权力或者企业所误用乃至利用,后果是非常可怕的。”

人脸识别是目前 AI 领域里应用最广泛的技术之一,但是带来的隐私问题也十分严重。

乔治城大学法隐私和技术中心的助理 Clare Garvie也表达了她的担忧。

人脸识别对言论自由的影响是潜在但不可忽视的。如果人脸识别技术被警方用于监控那些挑战公共权力的群众,那就好比用于在游行示威中,就如同警方在队伍中穿行,要求在场的每个人都出示身份证明。所有的群众都在争取政治权利的过程中加之亚马逊在科技领域的影响力,会有更多执法机构愿意参与进来。

微软这次的事件之所以引起各方关注,就是因为在上个月微软的AI 技术被用于在墨西哥边境分离非法入境者及其子女。事件被曝光后,微软短暂地在网站上删除了其与美国移民和海关执法局签订合同的文章,但仍然受到广泛抨击。

此外,由于人脸不仅仅能表明身份,透露的许多其他信息同样能由机器读取,更多人担心这些推测数据会被用于不正义的地方。

斯坦福大学的研究人员就表明,面对一个男同性恋者和一个异性恋者的照片时,算法识别他们性取向的准确率可以达到81%,而人类只能达到61%。在那些视同性恋为犯罪的国家,一个能从面部推断出性取向的软件让人恐惧。

今年五月,美国公民自由团体已经呼吁科技公司停止向政府提供面部识别服务,认为这是对公民权利的侵犯。各家公司都表示将更加谨慎地考虑这方面的合同,并敦促立法者规范人工智能技术的使用,避免这些技术受到执法者的滥用。

在欧盟,今年五月新出台的《GDPR数据保护法》已禁止企业在未获得用户特定同意的情况下收集人脸识别所需的生物特征数据。

诸多文章和质疑都表明,人脸识别被滥用的隐私和安全问题不能再放任不管了,政府必须在其中扮演立法者的角色,科技公司也不能对伦理问题视而不见,是时候应该好好地思考他们开发的技术所产生的道德影响和人权影响、以及使用过程中带来的风险。

结语

在圣经故事中,利维坦一只大水怪,因为不受控制,它凭借着巨大的身型攻城略地,把人类一个又一个的吃掉。

人脸识别技术,抑或是人工智能技术也一样,如果没有完善的法律约束使用这项技术的应用领域,保证他们用于合法、道德的场景,那么科技就会助纣为虐,而不是像科技公司所说的那样,改善我们的生活质量,让我们过上更加安全、舒适的生活。

所以人脸识别技术的明天不仅要追求精准的”高度”,更要守着公民权利的“底线”啊。

来源:声学在线